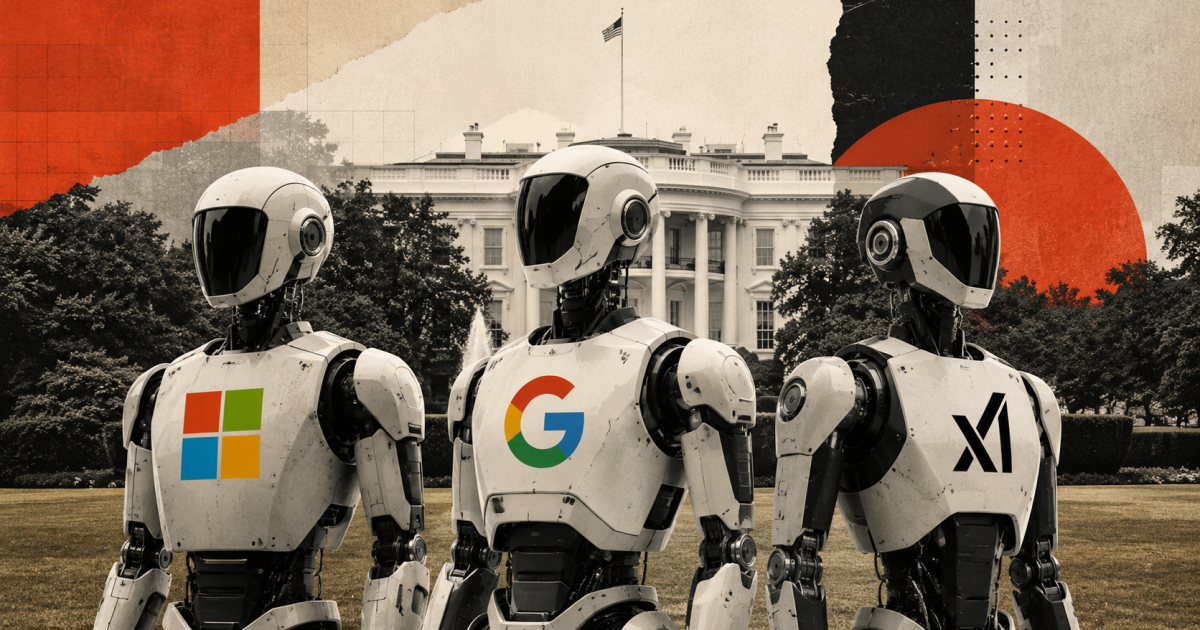

O NIST (Instituto Nacional de Padrões e Tecnologia) anunciou na terça-feira (5) que o Google, a Microsoft e a xAI compartilharão versões ainda não lançadas de seus modelos de inteligência artificial com o governo dos Estados Unidos para combater ameaças à segurança cibernética.

A parceria surge depois que o novo modelo de IA Mythos da Anthropic levou as preocupações sobre o impacto da IA na segurança cibernética a um ponto crítico no mês passado, ajudando a levar a Casa Branca a considerar um processo formal de revisão da IA.

Os novos acordos permitem que o CAISI (Centro de Padrões e Inovação em IA), vinculado ao Departamento de Comércio dos EUA, avalie novos modelos de IA e seu potencial impacto na segurança nacional e na segurança pública antes de seu lançamento.

O centro também realizará pesquisas e testes após a implementação dos modelos de IA e já concluiu mais de 40 avaliações de modelos de IA.

“A ciência de medição independente e rigorosa é essencial para a compreensão da IA de ponta e suas implicações para a segurança nacional”, disse Chris Fall, diretor do CAISI, em comunicado.

“Essas colaborações ampliadas com a indústria nos ajudam a expandir nosso trabalho em prol do interesse público em um momento crítico.”

Ferramenta que segundo a Anthropic está “muito à frente” de outros modelos em termos de cibersegurança, o Mythos gerou uma onda de preocupações entre governos, bancos e empresas de serviços públicos no último mês.

A empresa afirmou que ainda não se sente confortável em divulgar o modelo publicamente e está restringindo o acesso a um grupo seleto de organizações aprovadas. Ela também apresentou suas capacidades a altos funcionários do governo dos EUA.

A OpenAI também afirmou na semana passada que está disponibilizando seus modelos de IA mais avançados para todos os níveis governamentais devidamente aprovados, com o objetivo de se antecipar às ameaças facilitadas pela IA.

As parcerias podem facilitar os testes de IA pelo CAISI, fornecendo mais recursos, disse Jessica Ji, analista sênior de pesquisa do Centro de Segurança e Tecnologias Emergentes da Universidade de Georgetown.

“Eles simplesmente não têm a mesma quantidade de recursos [que as grandes empresas de tecnologia], como mão de obra, equipe técnica e também acesso a poder computacional, para selecionar esses modelos e realizar testes rigorosos”, disse Ji.

A Casa Branca está atualmente buscando consultar um grupo de especialistas para assessorar sobre um possível processo de revisão governamental para novos modelos de IA, confirmou a CNN Internacional.

Isso representaria uma mudança em relação à abordagem pouco intervencionista da administração Trump em relação à regulamentação da IA até o momento.

O jornal The New York Times foi o primeiro a noticiar a existência do grupo de trabalho na segunda-feira (4).

“Qualquer anúncio de política virá diretamente do presidente. Discussões sobre possíveis decretos executivos são mera especulação”, disse um porta-voz da Casa Branca à CNN Internacional.

Embora a Microsoft teste regularmente seus próprios modelos, o CAISI oferece conhecimento adicional “técnico, científico e de segurança nacional”, afirmou Natasha Crampton, Diretora de IA Responsável da Microsoft, em um comunicado.

O Google se recusou a comentar mais sobre o acordo. A xAI não respondeu aos pedidos de comentários.

Com informações de Lisa Eadicicco, da CNN Internacional